5жңҲ 29, 2023

В В В Ви®әж–Ү笔记вҖ”вҖ”[SIGGRAPH2023]Drag Your GAN: Interactive Point-based Manipulation on the Generative Image Mani...

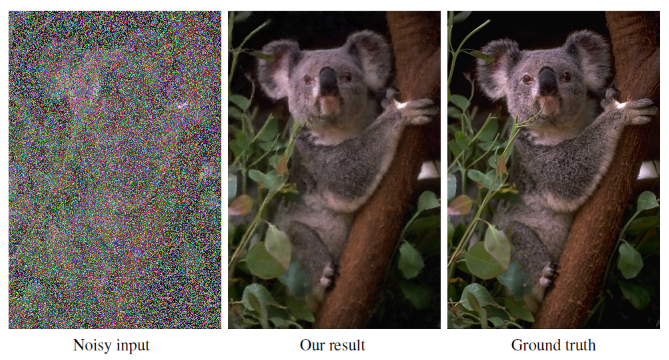

еҲӣж–°зӮ№пјҡ в‘ дәӨдә’ејҸзҡ„жҺ§еҲ¶еӣҫзүҮзҡ„еҸҳеҢ– з»ҷе®ҡдёҖеҜ№пјҲhandle point, target pointпјүпјҢжң¬ж–№жі•д»ҘдёҖз§ҚдјҳеҢ–зҡ„ж–№ејҸжү§иЎҢеӣҫеғҸж“ҚдҪңгҖӮеҰӮдёҠеӣҫжүҖзӨәпјҢжҜҸдёӘдјҳеҢ–жӯҘ...

2139 0